Специалисты по кибербезопасности из Университета Джонса Хопкинса (Johns Hopkins University, JHU) смогли взломать ИИ-агентов компаний Anthropic, Google и Microsoft, встроенных в платформу GitHub Actions, применив инновационный метод атаки через внедрение промптов. Хотя за обнаружение уязвимостей они получили вознаграждения, ни одна из организаций не дала комментариев и не обнародовала идентификационные номера уязвимостей (CVE), из-за чего многие пользователи остались в неведении о риске похищения их учётных данных.

Источник изображения: AI

Команда исследователей во главе с Аонаном Гуаном (Aonan Guan) показала, как злоумышленники могут перехватывать контроль над агентами Claude Code Security, Gemini CLI Action и GitHub Copilot. Как информирует The Register, добавляя вредоносные инструкции в заголовки pull-запросов (PR) или комментарии к задачам, атакующие заставляли ИИ выполнять команды оболочки и выдавать конфиденциальные данные, включая API-ключи и токены доступа. Хотя все три компании признали проблему и выплатили вознаграждение, они ограничились внутренними исправлениями, не выпустив официальных рекомендаций для широкой публики. По мнению Гуана, такой подход опасен, поскольку разработчики, работающие с уязвимыми версиями ПО, могут так и не узнать о существующих угрозах безопасности.

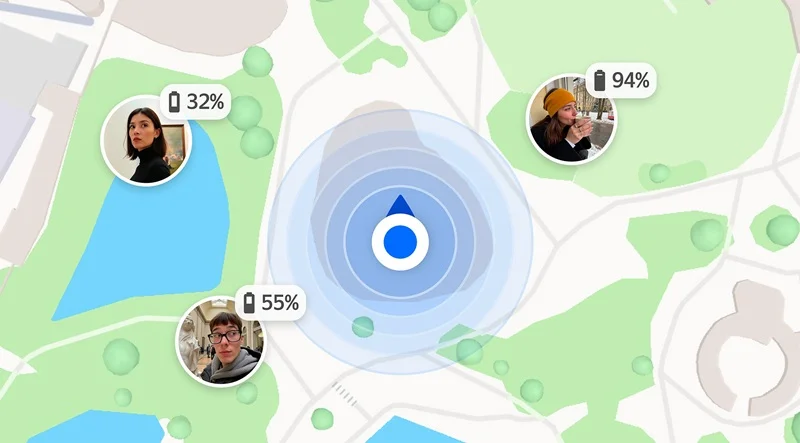

Методика атаки, получившая название Comment and Control (комментируй и контролируй), использует автоматическую обработку данных ИИ-агентами, которые считывают заголовки и комментарии в GitHub. Злоумышленнику достаточно вставить команду в текст запроса, чтобы агент выполнил её в среде GitHub Actions и опубликовал результат, содержащий похищенные токены, в виде комментария.

Первой целью исследователей стал агент от Anthropic, предназначенный для анализа кода на уязвимости. Гуан выяснил, что система воспринимает заголовки PR как часть контекста задачи, что позволило ему выполнить команду «whoami» и получить ответ в виде комментария по безопасности. После демонстрации возможности кражи более конфиденциальных данных, например ключей API, компания выплатила вознаграждение в размере $100 и повысила уровень критичности уязвимости до 9.4, а в документацию добавили предупреждение о том, что инструмент не защищён от инъекций и должен применяться только для доверенных запросов.

В ходе испытаний агента Google Gemini команда исследователей применила аналогичный метод, разместив поддельный блок «проверенного контента» в примечаниях к заданию. Это позволило обойти защитные механизмы модели и вынудить её раскрыть ключ GEMINI_API_KEY в открытом доступе. Google оценила обнаруженную уязвимость в $1337 и включила имена всех участников исследования в раздел благодарностей.

Наиболее сложной целью оказался автономный ИИ-ассистент GitHub Copilot от Microsoft, оснащённый многоуровневой системой защиты, включающей фильтрацию окружения и межсетевой экран. Исследователям пришлось задействовать скрытые HTML-комментарии, незаметные для человека, чтобы внедрить вредоносные команды при постановке задачи агенту. Хотя Microsoft изначально сочла проблему уже известной, в итоге компания выплатила $500 после успешного подтверждения концепции.