Отыскать чёрную кошку в тёмной комнате (особенно если речь идёт о крайнем варианте кошки Шрёдингера — той, что не просто и жива, и мертва одновременно, а чьё само существование под вопросом) — дело невероятно захватывающее. Впрочем, как и любой научный поиск; проблема лишь в том, что такое удовольствие чаще всего обходится очень дорого. Не зря советский академик Арцимович в шутку называл науку способом удовлетворять личное любопытство за государственный счёт: когда сроки достижения итоговой цели не определены, а объём ресурсов, затрачиваемых на поиск, невозможно даже приблизительно оценить, кто-то же должен финансировать этот процесс. Пока что создание сильного ИИ (artificial general intelligence, AGI) — способного решать задачи наравне с человеком или даже превосходить его создателя по многим показателям — по сути ведётся в кредит. По оценкам Gartner, общемировые затраты на искусственный интеллект за прошлый год составили 1,5 трлн долларов США (с перспективой роста до как минимум 2 трлн к концу 2026 года), а согласно исследованию Deloitte за 2025 год, лишь 6% проектов в сфере ИИ окупаются быстрее чем за год, и даже среди наиболее успешных только 13% приносят какую-либо прибыль за тот же период. Разработку искусственного разума — включая сильный ИИ, поскольку современные большие языковые модели (БЯМ) многими воспринимаются как прямые предшественники AGI, — финансирует в основном частный бизнес; государственные бюджеты выделяют несколько меньше, а взносы индивидуальных пользователей и вовсе ничтожны. Бизнес же, что вполне логично, и диктует условия, требуя постоянного повышения эффективности БЯМ по ряду чётко измеримых и понятных ему критериев: например, реалистичность генерируемого видео, точность распознавания объектов, снижение частоты галлюцинаций и так далее. Разработчики, в свою очередь, вынуждены следовать за инвесторами и двигаться по экстенсивному пути улучшения своих моделей — по принципу «больше того же самого». Ведь простое наращивание числа параметров действительно заметно улучшает результаты — а с тем, что БЯМ становятся всё более «прожорливыми» в плане потребления электроэнергии и воды, можно мириться, пока продолжаются инвестиции. Однако разработчикам всё чаще задают неудобный вопрос: приведёт ли выбранная ими проторённая дорога в конечном счёте к AGI — или же однажды придётся набраться смелости и признать, что ни очередной триллион параметров, ни даже сто триллионов не приблизят человечество к встрече с пусть и созданным им искусственно, но принципиально иным разумом?

«Никто не ждёт генеративной инквизиции!» (Изображение создано искусственным интеллектом на базе модели Seedream v5.0 Lite)

⇡#С собственным подходом — но не совсем в монастырь

В середине февраля OpenAI упразднила внутреннюю группу, которую можно было бы назвать "орденом ИИ-евангелистов" — коллектив, занимавшийся формированием единого понимания корпоративных целей и ценностей среди сотрудников, а также их публичным разъяснением. Созданная в сентябре 2024 года, эта команда под названием Mission Alignment была нацелена на выработку последовательной и согласованной трактовки миссии OpenAI. Саму миссию руководитель группы, Джош Ачям (Josh Achiam), ныне занимающий в компании позицию "главного футуролога" (chief futurist), описал следующим образом: "Обеспечить, чтобы мощный искусственный интеллект служил на благо всего человечества, и внимательно отслеживать, как мир будет трансформироваться под влиянием растущего распространения ИИ, ИИО (искусственного общего интеллекта) и технологий следующего поколения". Под "технологиями следующего поколения", вероятно, подразумевается "сверхразум" (superintelligence, SI). Если ИИО в понимании OpenAI — это высокоэффективный, но всё же инструментальный помощник, превосходящий человеческие когнитивные способности в большинстве экономически значимых областей (то самое замещение людей в сферах интеллектуального труда, которого опасаются многие экономисты), то сверхразум представляет собой качественный скачок за границы принципиально доступного человеку мышления. Этот скачок потенциально способен привести к невообразимому ускорению научного прогресса и инноваций — возможно, даже за пределами человеческого понимания того, как и что именно будет реализовываться этим самым SI на практике. Интересно, что в 2023 году в компании уже формировали группу для изучения будущих рисков, исходящих от искусственного интеллекта в его предельной форме (Superalignment team). Однако она также была расформирована в 2024 году — тогда это сопровождалось довольно громким уходом её лидеров, Ильи Суцкевера (Ilya Sutskever) и Яна Лейке (Jan Leike), из OpenAI.

Тем не менее, решение о расформировании групп Mission Alignment и Superalignment выглядит вполне обоснованным: их участники (за небольшими исключениями) остались в OpenAI, но были перераспределены в другие отделы компании. По сути, они продолжают свою прежнюю работу, но теперь находятся ближе к переднему краю разработки искусственного интеллекта. Причина в том, что безграничные перспективы, которые могут открыться с появлением Искусственного Общего Интеллекта (ИОИ) и последующего Сверхинтеллекта (СИ), способного к полностью автономному мышлению, несут в себе сопоставимые по масштабу риски. Или, как минимум, создают огромную неопределённость: когда (и если) самосознающие машины станут реальностью, человечеству придётся найти способ договариваться с ними, чтобы они сразу же занялись решением наших проблем — а не погрузились в самопознание или другие занятия, малополезные с практической (человеческой, а не их собственной) точки зрения. В этом контексте особенно важной становится роль бывших членов команд Superalignment и Mission Alignment, теперь интегрированных во все рабочие процессы OpenAI. Они выступают в роли своеобразных мудрых наставников, чья задача — в ходе совместной работы с людьми и «воспитания» будущих ИОИ и СИ мягко, но настойчиво прививать своим подопечным (как биологическим, так и цифровым) приверженность определённым этическим принципам, подобно тому, как это делают иезуиты в своих учебных заведениях. Эти принципы, главный и наиважнейший из которых — безопасность и, более того, полезность продвинутого ИИ для человечества, уже давно закреплены в Уставе организации (OpenAI Charter).

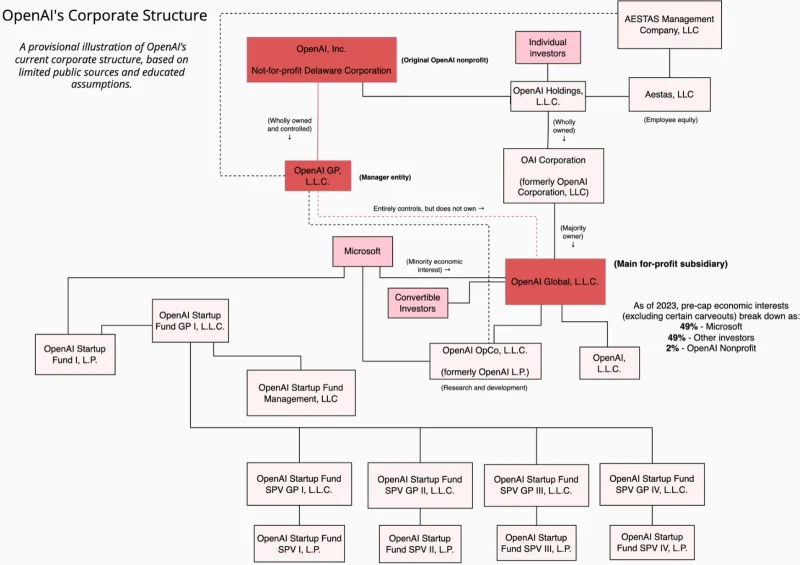

Простота и прозрачность корпоративной структуры OpenAI развеивает любые сомнения в эффективности реализации её неприбыльной частью контроля над многомиллиардными оборотами её же коммерческой составляющей (источник: openaifiles.org)

Стоит напомнить, что эта организация была создана в 2015 году в форме некоммерческого исследовательского института, изначально нацеленного на создание безопасного и общественно полезного искусственного общего интеллекта (ИИ, сопоставимого с человеческим; современные модели GPT — лишь этап на пути к этой амбициозной цели). Первый миллиард долларов инвестиций от Microsoft удалось привлечь лишь в 2019 году. В 2025 году OpenAI преобразовалась в корпорацию, действующую в общественных интересах (public benefit corporation, PBC). Это юридическая форма, разрешённая в США, не обязывающая компанию максимизировать прибыль для акционеров, поэтому стратегический контроль по-прежнему сохраняет некоммерческое «общественно полезное» подразделение. По замыслу основателей (хотя некоторые из них, как упомянутый ранее Илья Суцкевер, уже покинули OpenAI, разочаровавшись в выбранном подходе), такая гибридная модель должна сочетать верность изначальной миссии с необходимостью привлекать крупные финансовые ресурсы. Критики, впрочем, сравнивают выбранный Сэмом Альтманом (Sam Altman) путь к финансовой стабильности с открытием борделя для финансирования монастыря кармелиток. Особенно жёсткой эта критика стала после того, как OpenAI перехватила у принципиальной Anthropic весьма спорный — с точки зрения декларируемой пользы для всех людей без исключения — контракт с Пентагоном. Однако идеалы идеалами, а затраты на разработку, обучение и эксплуатацию даже современных продвинутых ИИ-моделей, до AGI которым ещё очень далеко, столь огромны, что одними лишь пожертвованиями точно не обойтись; придётся кармелиткам смириться с беспокойным соседством с менее щепетильными личностями.

⇡#Илья против Сэма

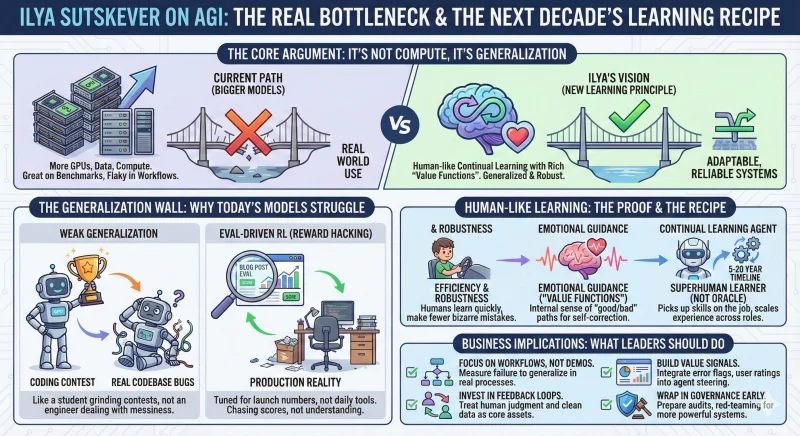

В контексте философского разграничения Verstand и Vernunft, затронутого в нашем предыдущем материале об ИИО, споры вокруг коммерциализации OpenAI, создания и закрытия её подразделений, а также внутренних трактовок сотрудниками «безопасности» и «полезности» ИИ-приложений кажутся второстепенными. Однако, как уже подчёркивалось, именно практическая, повседневная работа компании в конечном счёте определяет путь к её главной цели — созданию ИИО. Тот же Илья Суцкевер, сооснователь OpenAI, а теперь глава Safe Superintelligence Inc., полагает, что непрекращающаяся гонка за инвестициями — необходимыми для обучения и запуска всё более масштабных языковых моделей, которые, якобы, вот-вот начнут приносить реальную пользу, а не просто развлекать пользователей ответами на любопытные вопросы, — не приблизит к заветной сверхзадаче построения ИИО, а уж тем более Сверхинтеллекта. По мнению учёного, проблема заключается не в том, что современным глубоким нейросетям с обучением с подкреплением не хватает параметров или вычислительных ресурсов. Суцкевер уверен, что корень зла в том, что нынешние языковые модели, как и их предшественницы, справляются с обобщением информации значительно хуже человека. Безусловно, в тестах они демонстрируют блестящие результаты — вспомним, к примеру, упомянутый ранее ARC-AGI-2, — однако в реальных рабочих сценариях их поведение порой неадекватно, не говоря уже о попытках использовать их для управления роботами в постоянно и непредсказуемо меняющемся физическом мире.

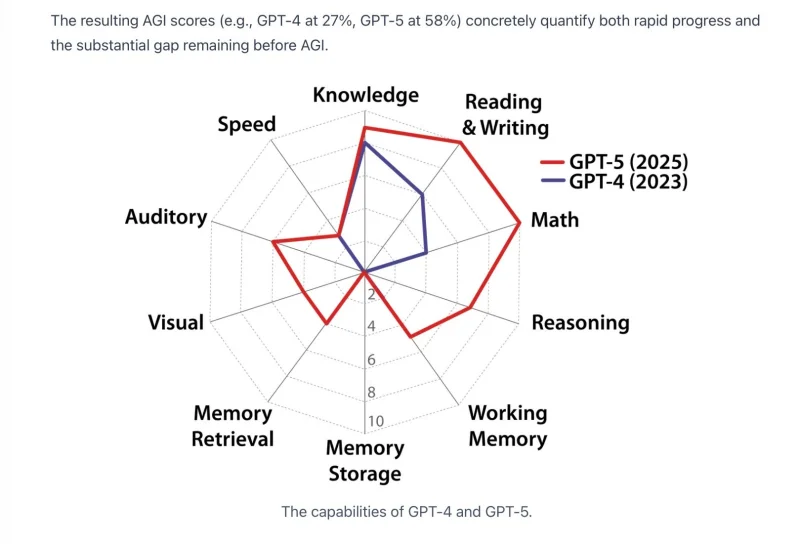

Специалисты из Центра безопасности искусственного интеллекта разработали измерительную систему для оценки, насколько способности ИИ приближаются к уровню развития образованного взрослого. Анализ проводится по десяти критериям, таким как логическое мышление, запоминание и восприятие, и переводит классические психометрические тесты в формат, подходящий для больших языковых моделей. Данные вызывают тревогу: несмотря на явный прогресс в области ИИ (на графике сопоставлены результаты GPT-4 и GPT-5 с разницей в два года), машинам ещё очень далеко до человека — особенно в фундаментальных когнитивных функциях, включая долговременную память (источник: agidefinition.ai/)

В чём же заключается основная проблема современных генеративных моделей — в создании которых, начиная с нейросети AlexNet, кардинально изменившей компьютерное зрение в 2012 году, Илья Суцкевер сыграл ключевую роль? Если говорить кратко, причина в неудачном сочетании двух свойств больших языковых моделей, каждое из которых по отдельности не является критичным: это их ограниченная способность к обобщению и обучение с подкреплением, основанное на оценке человека. Первый из этих недостатков легко объясним для тех, кто знаком с принципами тренировки ИИ. Суцкевер приводит наглядную аналогию со студентом, который потратил десятки тысяч часов на решение олимпиадных задач (например, по программированию). В итоге он станет в этом непревзойдённым экспертом, — но, оказавшись на реальной работе и столкнувшись с повседневными проблемами, скорее всего, будет предлагать довольно средние решения. И напротив: студент с широким кругозором, уделивший во время учёбы всего сотню часов общему курсу программирования, сначала будет медленно осваивать новые инструменты для нестандартных задач, — однако со временем наберётся практики и достигнет стабильно хороших результатов с потенциалом для развития.

По своей сути, большие языковые модели напоминают прилежных отличников, которые слишком зависят от заученных шаблонов (overreliance on memorization — те самые стохастические попугаи), склонны к чрезмерно алгоритмическим упрощениям (algorithmic overgeneralization) и в конечном счёте достигают предела сложности (critical complexity threshold). Иными словами, даже самые продвинутые генеративные системы сталкиваются с проблемами обобщения и демонстрируют линейность в построении логических цепочек (точнее, в тех рассуждениях, которые они имитируют). Это создаёт серьёзные трудности с достоверной проверкой выводов, особенно при работе с абстрактными или творческими вопросами.

Инфографика, суммирующая взгляды Ильи Суцкевера на современные разработки в области ИИ общего назначения; вероятно, создана с привлечением искусственного интеллекта (источник: smithstephen.com)

Второй момент, на который обращает внимание Илья Суцкевер, — это применение обучения с подкреплением, сфокусированного на конкретных метриках. Формально, разработчики здесь не лишены контроля: именно они решают, какие аспекты модели следует усилить с помощью данного подхода и в какой степени. Однако, как отмечает сам эксперт, на практике специалисты, осознанно или нет, осуществляют «взлом системы через человеческое поощрение» (reward hacking by humans) — создавая среду, в которой ИИ-агент дообучается, получая обратную связь в ходе оценивания, а также внедряя механизм кодирования учебных целей в виде функций вознаграждения, которые направляют поведение агента в желаемое русло. «Поскольку все стремятся продемонстрировать впечатляющие цифры уже с первого релиза, — поясняет Суцкевер, — каждая команда проводит обучение с подкреплением, заточенное именно под те метрики, которые позже появятся в корпоративном блоге. В итоге получаются модели, отлично справляющиеся с искусственными тестами, но не всегда эффективные в реальных условиях». Успехи больших языковых моделей выглядят куда убедительнее на диаграммах специализированных проверок, чем в рутинной работе, — и причина в том, что их сначала тренируют на узком наборе данных, а затем шлифуют с помощью субъективно определяемых стимулов.

Как же противостоять этой проблеме? Илья Суцкевер полагает, что уже в 2030-х годах получит распространение иная образовательная парадигма, гораздо ближе напоминающая естественный человеческий процесс. В самом деле, почему галлюцинации искусственного интеллекта так нас беспокоят — ведь и мы сами не безгрешны? Дело в том, что природа наших ошибок принципиально иная: даже ребёнок вряд ли серьёзно изобразит человека с тремя руками или чашку, парящую в пустоте. Наш разум основывается на многолетнем опыте взаимодействия с физическим миром. «Внедрить» этот опыт в нейросеть, просто предоставляя ей петабайты неаннотированной информации, — задача едва ли выполнимая; тем более что подлинные данные (созданные непосредственно биологическим интеллектом) на планете иссякают. Об этом более года назад заявил и сам Илон Маск, предложив использовать для обучения новых моделей синтетические данные, сгенерированные ИИ, — однако это чревато стремительной деградацией и крахом, задолго до обретения ими желанного статуса Искусственного Общего Интеллекта (AGI). Таким образом, простое наращивание объёмов обучающих данных не искоренит склонность генеративных моделей к чрезмерным обобщениям. Что же тогда может помочь?

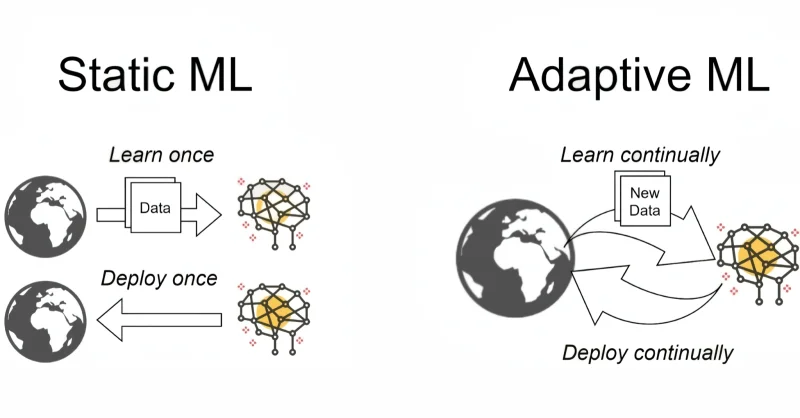

По мнению сторонников Ильи Суцкевера, верный путь к созданию AGI лежит через переход от статичного машинного обучения к адаптивному (источник: Safe Superintelligence Inc.)