Китайское ведомство по регулированию киберпространства (CAC) вынесло на общественное обсуждение проект положений, регламентирующих работу сервисов на основе искусственного интеллекта в стране, информирует агентство Reuters.

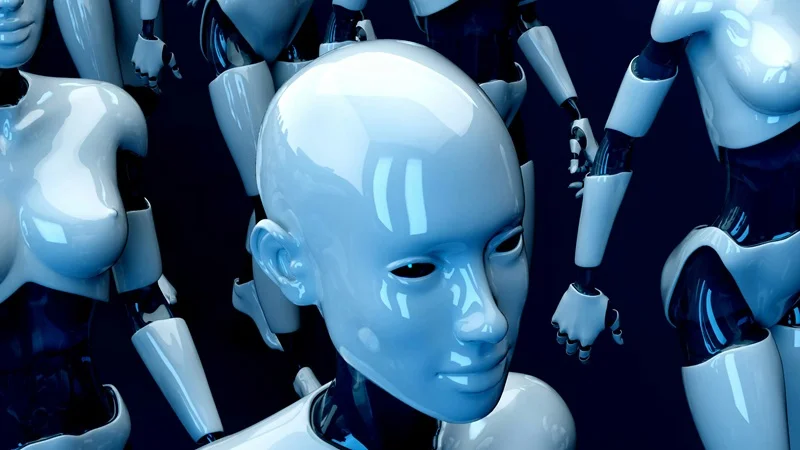

Источник изображения: julien Tromeur/unsplash.com

Как сообщается на официальной странице CAC в WeChat, предлагаемые нормы будут распространяться на продукты и услуги, которые задействуют технологии ИИ для воспроизведения человеческих личностных черт, логики мышления и манеры общения, а также обеспечивают эмоциональный контакт с пользователями в Китае через текст, изображения, звук или видео.

Регулятор подчеркнул, что проект разработан с учётом комплексного, сбалансированного и многоуровневого подхода к регулированию, предусматривающего дифференцированный контроль в зависимости от степени риска, что призвано одновременно стимулировать инновации и предотвращать возможные злоупотребления.

Проектом документа запрещается генерирование и распространение материалов, создающих угрозу национальной безопасности, наносящих урон престижу или интересам государства, подрывающих национальное единство, пропагандирующих незаконную религиозную деятельность, распространяющих слухи, дестабилизирующие экономический или общественный порядок, а также содержащих порнографию, элементы азартных игр, насилия или призывы к противоправным действиям.

Также воспрещается публикация контента, который одобряет или романтизирует суицид либо самоповреждение, а также такие практики, как вербальные оскорбления или эмоциональное давление, способные причинить вред физическому или психическому здоровью пользователей или унизить их достоинство.

Согласно документу, поставщики сервисов на основе ИИ обязаны нести ответственность за обеспечение безопасности на всех этапах жизненного цикла продукта и формировать системы для аудита алгоритмов, защиты данных и сохранения конфиденциальности личной информации.

Провайдеры должны уведомлять пользователей о том, что они взаимодействуют с искусственным интеллектом, а не с живым человеком, и предостерегать их от потенциального вреда чрезмерного использования. Им также вменяется в обязанность оценивать эмоциональное состояние пользователей и уровень их зависимости от сервиса. В тексте указано, что при выявлении у пользователей интенсивных эмоциональных реакций или аддиктивного поведения провайдеры обязаны предпринимать соответствующие меры.

Линь Вэй (Lin Wei), ректор Юго-Западного университета политических наук и права, в пояснительной записке к проекту отметил, что достижения в области ИИ-технологий преобразуют взаимодействие человека и машины, выводя его за рамки простого функционального содействия в сферу эмоционального и индивидуального общения. Эта трансформация, меняя модели социальных коммуникаций, одновременно создаёт ряд новых рисков и проблем.

Исследователь подчеркнул, что предложенные регуляторные меры призваны контролировать угрозы, порождаемые именно антропоморфными чертами (наделением объектов человеческими качествами) и эмоциональной вовлечённостью, акцентируя внимание на стирании различий между людьми и технологиями.