Компания Microsoft представила комплекс стандартов, предназначенных для оценки достоверности информации, публикуемой в сети. Эксперты корпорации проанализировали эффективность существующих способов фиксации цифровых искажений, включая deepfake и гиперреалистичные изображения, созданные искусственным интеллектом. Результатом этой работы стали технические спецификации, которые могут быть внедрены разработчиками ИИ-систем и операторами социальных платформ.

Источник изображения: Aidin Geranrekab / unsplash.com

Принцип проверки контента в Microsoft проиллюстрировали на примере установления подлинности полотна Рембрандта. Для этого можно восстановить его провенанс, зафиксировав все места пребывания и переходы между владельцами. Другой подход — оцифровать картину и создать на основе уникальных особенностей мазков математическую сигнатуру, аналогичную отпечатку пальца. Посетитель музея, усомнившийся в оригинальности работы, получит возможность изучить эти данные и подтвердить её аутентичность.

Подобные методики в различных формах уже применяются для анализа сетевого контента. Специалисты Microsoft оценили 60 разных комбинаций таких методов и смоделировали их работу в разнообразных условиях — от простого удаления метаданных до целенаправленной модификации или фальсификации материалов. В ходе исследования было определено, какие сочетания обеспечивают достаточную надёжность для публичного использования, а какие могут лишь усугубить неразбериху вместо того, чтобы дать чёткий ответ.

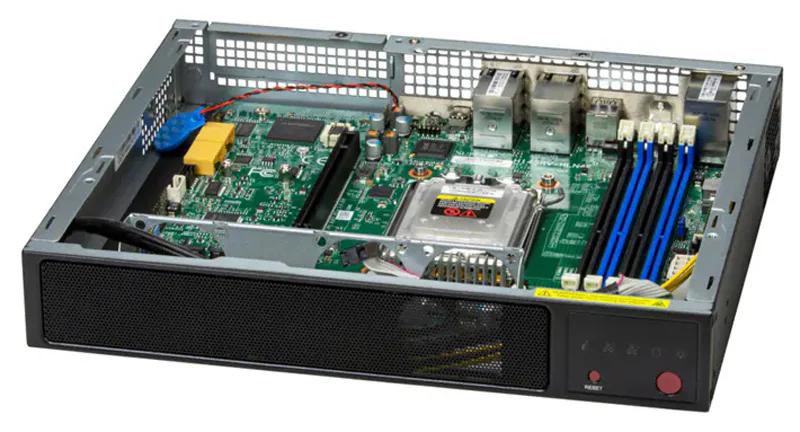

Необходимость в подобной инициативе обусловлена растущим числом законодательных мер, включая «Закон о прозрачности ИИ», который начнёт действовать в августе в штате Калифорния. Однако в Microsoft пока воздерживаются от комментариев, будут ли эти стандарты использоваться в собственных продуктах компании. В её портфель входят ИИ-сервисы Copilot для генерации текстов и изображений, облачная платформа Azure для запуска моделей ИИ, доля в разработчике OpenAI, а также профессиональная сеть LinkedIn.

Источник изображения: Steve Johnson / unsplash.com

Подчёркивается, что инструменты, представленные Microsoft, не служат для установления истинности или ложности контента как такового — они лишь демонстрируют, подвергался ли материал цифровым манипуляциям, тем самым раскрывая его происхождение. По мнению аналитиков, широкое внедрение подобных решений в индустрии значительно усложнило бы введение аудитории в заблуждение с помощью сфабрикованных данных.

В 2021 году Microsoft представила стандарт C2PA, призванный отслеживать источник происхождения контента; начиная с 2023 года Google стала маркировать материалы, созданные искусственным интеллектом, специальными метками; однако полный пакет инструментов, который сейчас предлагает Microsoft, может так и остаться лишь инициативой, если игроки рынка усмотрят в нём риски для своих коммерческих стратегий.

Действующие решения не гарантируют абсолютной точности: как показало исследование, лишь 30% пробных публикаций в Instagram✴, LinkedIn, Pinterest, TikTok и YouTube были корректно помечены как сгенерированные ИИ. Поэтому поспешное внедрение отдельных средств проверки сопряжено с рисками — в случае частых ошибок пользователи просто утратят к ним доверие. Более устойчивыми выглядят комплексные системы верификации. Например, если достоверное изображение было лишь слегка отредактировано с помощью ИИ, платформы могут ошибочно классифицировать его как полностью созданное искусственным интеллектом — комплексная проверка с меньшей вероятностью приведёт к подобной ложной тревоге.