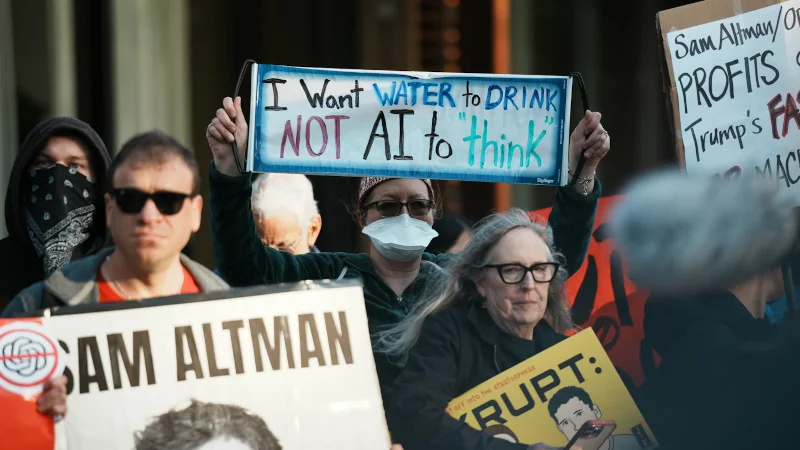

OpenAI снова оказалась в эпицентре скандала, касающегося доверия к её руководству. Толчком послужила свежая статья о генеральном директоре Сэме Альтмане (Sam Altman), после чего дискуссия об опасностях искусственного интеллекта сместилась с самой технологии на тех, кто принимает важнейшие решения. В центре внимания оказались прежние упрёки в неискренности Альтмана, новые заявления его бывших коллег и собственный отчёт OpenAI о возможных серьёзных последствиях массового внедрения ИИ.

Источник изображения: @sama / x.com

Материал Ронана Фэрроу (Ronan Farrow) и Эндрю Маранца (Andrew Marantz) в The New Yorker сводит все обвинения в адрес Альтмана к одному итогу: часть тех, кто с ним работал, считает его уклончивым и ненадёжным. Один из бывших членов совета директоров OpenAI формулирует это предельно жёстко: «Для него правда не является ограничением». Сам упрёк не нов. Осенью 2023 года совет директоров OpenAI уволил Альтмана, заявив, что он «не был неизменно откровенен в своих высказываниях и общении». Позже Альтман вернулся на пост главы компании, а большинство его оппонентов покинули OpenAI.

Разногласия с бывшими коллегами после этого никуда не делись. Несколько ИИ-стартапов основали люди, которые ранее работали с Альтманом, а затем стали его противниками. Самый яркий пример — компания Anthropic, которой руководит бывший топ-менеджер OpenAI Дарио Амодеи (Dario Amodei). Его неприязнь к Альтману уже давно стала частью публичного конфликта между выходцами из OpenAI.

Источник изображения: Steve Johnson / unsplash.com

Новые разногласия, как сообщает пресса, затронули и нынешнее руководство компании. The Information пишет, что у Альтмана не ладятся отношения с финансовым директором Сарой Фрайар (Sarah Friar). Для OpenAI, которая готовится к выходу на биржу в 2026 году, такой конфликт имеет прямое значение. По данным издания, Фрайар ранее в 2026 году говорила коллегам, что не считает компанию готовой к первичному размещению акций (IPO).

OpenAI опровергла слухи о внутренних конфликтах. В ответ на статью The Information компания опубликовала совместное заявление Альтмана и Фрайар, где утверждается, что оба руководителя на протяжении последнего года лично принимали участие во всех ключевых решениях, касающихся вычислительной инфраструктуры. Таким образом, OpenAI попыталась опровергнуть утверждения о том, что Фрайар была отстранена от обсуждения важнейших финансовых вопросов. Кроме того, компания раскритиковала публикацию The New Yorker, отметив, что большая часть материала представляет собой пересказ уже известных фактов, основанный на анонимных источниках и избирательно подобранных свидетельствах лиц, имеющих явную личную заинтересованность.

Источник изображения: Nathan Kuczmarski / unsplash.com

Конфликт вокруг доверия к Альтману обострился именно в тот момент, когда OpenAI призвала к обсуждению регулирования передовых систем искусственного интеллекта. В докладе Industrial Policy for the Intelligence Age: Ideas to Keep People First компания утверждает, что ИИ способен принести значительную пользу, но одновременно несет серьезные угрозы. Среди них — исчезновение рабочих мест и целых отраслей, злоупотребление технологией злоумышленниками, потеря контроля над ИИ, использование ИИ государствами и институтами во вред демократическим ценностям, а также усиление концентрации власти и богатства в руках корпораций.

OpenAI связывает эти риски со своей первоначальной миссией. Компания напоминает, что в 2015 году Альтман и его сооснователи основали некоммерческую организацию именно для того, чтобы помогать сдерживать такие угрозы. Сегодня OpenAI работает по гибридной модели, сочетающей коммерческое и некоммерческое управление. В том же докладе компания предлагает конкретные практические шаги: изменить налоговое законодательство, чтобы увеличить сборы с крупных корпораций и состоятельных людей и компенсировать возможное сокращение поступлений от налогов на заработную плату, если ИИ вытеснит с рынка большое количество работников, а также ввести дополнительные налоги для компаний, заменяющих людей искусственным интеллектом.