AWS и NVIDIA объявили о дальнейшем развитии стратегического партнёрства. Оно охватывает области высокопроизводительных вычислений, технологий межсоединений, адаптации ИИ-моделей и их промышленного применения. В рамках планов AWS развернёт в своих глобальных дата-центрах свыше 1 миллиона новых ИИ-ускорителей NVIDIA, включая архитектуры Blackwell и Rubin, а также сетевые решения NVIDIA Spectrum.

Идёт подготовка к выпуску новых вычислительных инстансов EC2, основанных на ускорителях NVIDIA RTX Pro 4500 Blackwell Server Edition. AWS стала первым крупным облачным оператором, заявившим о поддержке этих процессоров. Данные инстансы созданы для задач аналитики, голосовых ИИ-ассистентов, создания контента, рекомендательных сервисов, потокового видео, видеомонтажа и других. Их основой станет платформа AWS Nitro.

С масштабированием инфраструктуры возрастает важность эффективного взаимодействия между ускорителями NVIDIA и чипами AWS Trainium. Партнёры заявили о поддержке библиотеки NVIDIA Inference Xfer Library (NIXL) и адаптера AWS Elastic Fabric Adapter (EFA), что ускорит распределённое выполнение ИИ-моделей на EC2. Такая архитектура распределённого инференса оптимизирует баланс между вычислениями и обменом данными, сокращает время отклика и повышает загрузку ИИ-ускорителей. NIXL в связке с EFA будут работать с распространёнными открытыми фреймворками, такими как NVIDIA Dynamo, vLLM и SGLang.

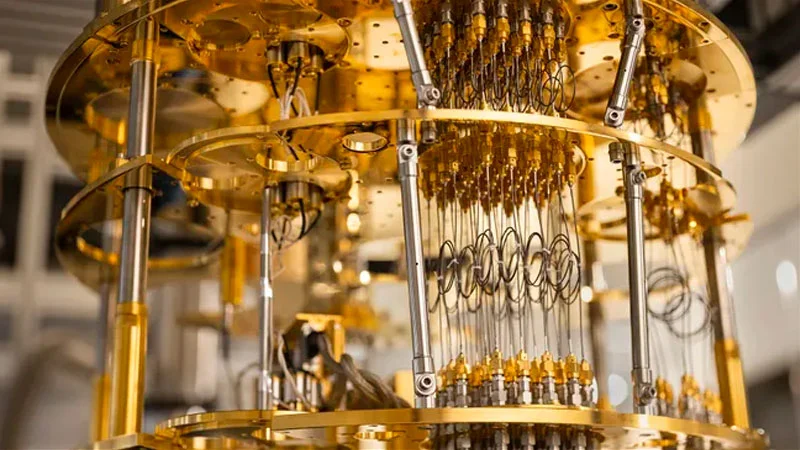

Источник изображения: AWS

Кроме того, AWS и NVIDIA сообщили о внедрении Apache Spark в составе Amazon EMR на платформе Amazon EKS с использованием инстансов G7e на базе ускорителей NVIDIA RTX Pro 6000 Blackwell, что ускорит обработку данных в три раза. При этом обеспечивается полная совместимость с существующими приложениями Spark.

Завершая анонсы, компании рассказали о расширении доступности ИИ-моделей NVIDIA Nemotron в сервисе Amazon Bedrock, включая их тонкую настройку для юридической, медицинской, финансовой и других отраслей. Вся инфраструктура управляется через Bedrock, что существенно облегчает работу разработчиков. В ближайшее время ожидается появление гибридной MoE-модели NVIDIA Nemotron 3 Super для сфер финансов, кибербезопасности, розничной торговли, создания программного обеспечения и других.

Компании разработали комплексную инфраструктуру для искусственного интеллекта, охватывающую всё — от специализированных ускорителей и сетевых решений до облачных сервисов под управлением. Такой подход даёт клиентам возможность ускорить внедрение ИИ-технологий, избавляя от необходимости самостоятельно собирать систему из отдельных элементов. По данным издания Datacenter Dynamics, в феврале 2026 года руководитель AWS Мэтт Гарман отметил, что в ряде серверов компания продолжала применять более ранние ускорители NVIDIA A100, поскольку спрос на них оставался значительным.

Широкое распространение платформы NVIDIA Blackwell Ultra началось в декабре 2025 года, а в ближайшей перспективе ожидается предоставление доступа и к ускорителям Rubin. Параллельно компания намерена увеличить инвестиции в развитие собственных чипов Trainium. В феврале OpenAI сообщила о планах задействовать в облаке AWS мощности объёмом 2 ГВт на базе Trainium и других ускорителей, что во многом стало возможным благодаря инвестициям Amazon в размере $50 млрд.

Источник: