Согласно оценкам Bloomberg, на долю азиатских производителей сегодня приходится приблизительно 90 % затрат Nvidia на производство, тогда как годом ранее этот показатель составлял 65 %. В эту цифру входит сложившаяся цепочка поставок компонентов Nvidia для дата-центров: выпуск чипов на мощностях TSMC, память HBM от SK hynix и Samsung, а также сборка серверов на предприятиях Foxconn и Quanta. Однако сейчас Nvidia создаёт совершенно новые категории ИИ-продуктов, которые выпускаются теми же компаниями.

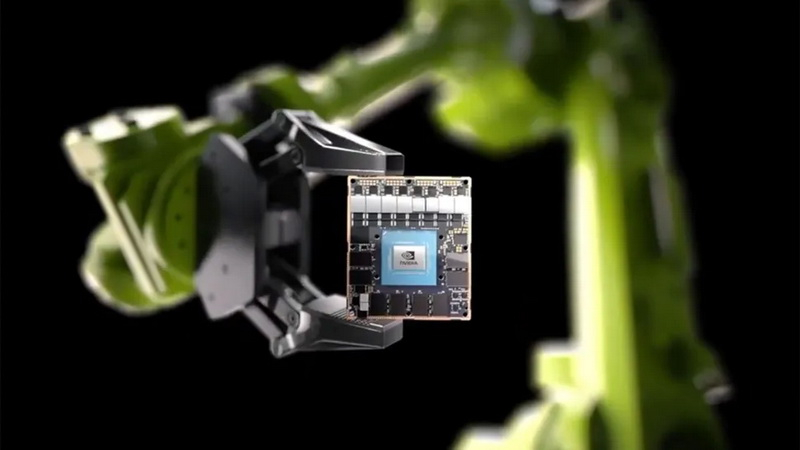

Источник изображения: Nvidia

Робототехническая платформа Jetson Thor от Nvidia, представленная в августе прошлого года, базируется на графической архитектуре Blackwell и изготавливается по 3-нм технологии TSMC. Флагманская версия T5000 достигает производительности 2070 Тфлопс в режиме FP4 и оснащается 128 Гбайт памяти LPDDR5X, а более доступная модель T4000, анонсированная на выставке CES 2026, обеспечивает 1200 Тфлопс в режиме FP4 и имеет 64 Гбайт памяти. Её стоимость составляет $1999 за штуку. Обе модели используют процессорные ядра Arm Neoverse-V3AE и память LPDDR5X от Samsung или SK hynix. Эти системы конкурируют за доступ к производству 3-нм кремниевых пластин TSMC с графическими процессорами Blackwell для центров обработки данных. Производственные партнёры Nvidia, включая Boston Dynamics и Amazon Robotics, активно применяют эту платформу, а компания LG подтвердила, что «рассматривает возможность стратегического партнёрства с Nvidia в области физического искусственного интеллекта», в том числе в робототехнике, сообщает Bloomberg.

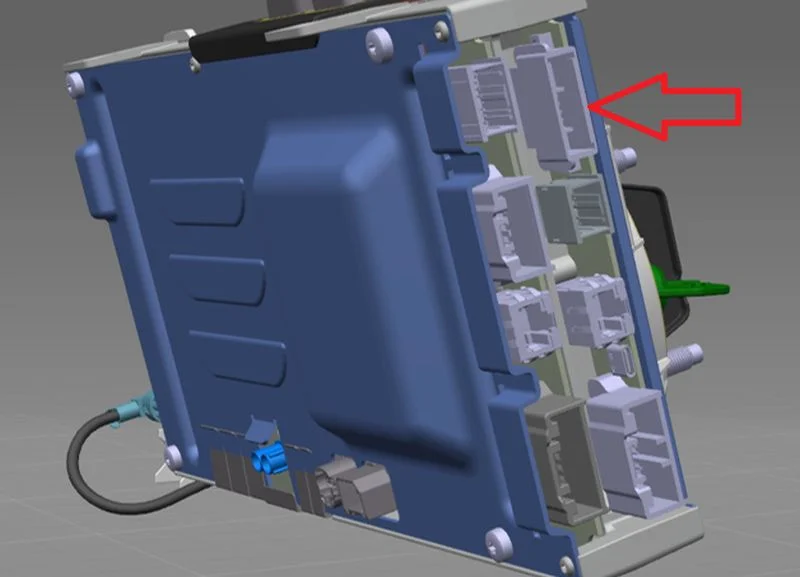

Автомобильная система на кристалле Drive AGX Thor от Nvidia представляет собой ещё одну линейку продуктов на базе Blackwell, которая борется за те же 3-нм производственные ресурсы. Ни один из этих продуктов для физического искусственного интеллекта не требует передовой упаковки CoWoS от TSMC, которая по-прежнему остаётся главным узким местом в выпуске графических процессоров для дата-центров. Однако для их производства необходимы 3-нм пластины и память LPDDR5X азиатского производства, доступ к которым уже ограничен.

Та же ситуация на рынке памяти, которая способствует появлению новых продуктов Nvidia для физического искусственного интеллекта, одновременно ведёт к отказу от устаревших технологий. В конце апреля стало известно, что Nvidia ускорила вывод из эксплуатации модулей Jetson TX2 и Xavier, так как поставки LPDDR4 стали слишком ограниченными для поддержания производства.

Компания Samsung прекратила выпуск памяти LPDDR4, а растущий спрос, связанный с развитием искусственного интеллекта, перенаправил производственные мощности на более выгодные продукты. В результате клиенты Jetson вынуждены переходить на модули Orin или Thor, в которых применяется память LPDDR5X от тех же азиатских производителей, чьи возможности уже перегружены из-за потребности в HBM и DRAM для дата-центров.

Как сообщил руководитель североамериканского подразделения TSMC, занимающегося упаковкой чипов, выпуск передовых корпусов CoWoS для графических процессоров, предназначенных для центров обработки данных, в TSMC ежегодно увеличивается в среднем на 80%. При этом чипы, произведённые на заводе TSMC в Аризоне, всё ещё отправляются на Тайвань для корпусирования.

В прошлом году Nvidia вложила $500 млрд в организацию производства серверов в США совместно с Foxconn и Wistron, а также с Amkor и SPIL, которые возводят в Аризоне заводы для выпуска усовершенствованных корпусов. Однако эти предприятия пока не достигли полной производственной мощности, а линейки продуктов для искусственного интеллекта расширяют перечень компонентов, поставляемых из Азии, быстрее, чем местные производители способны их освоить.